大模型配置指南

本指南将帮助您快速配置本地或远程大模型,以满足推理需求。

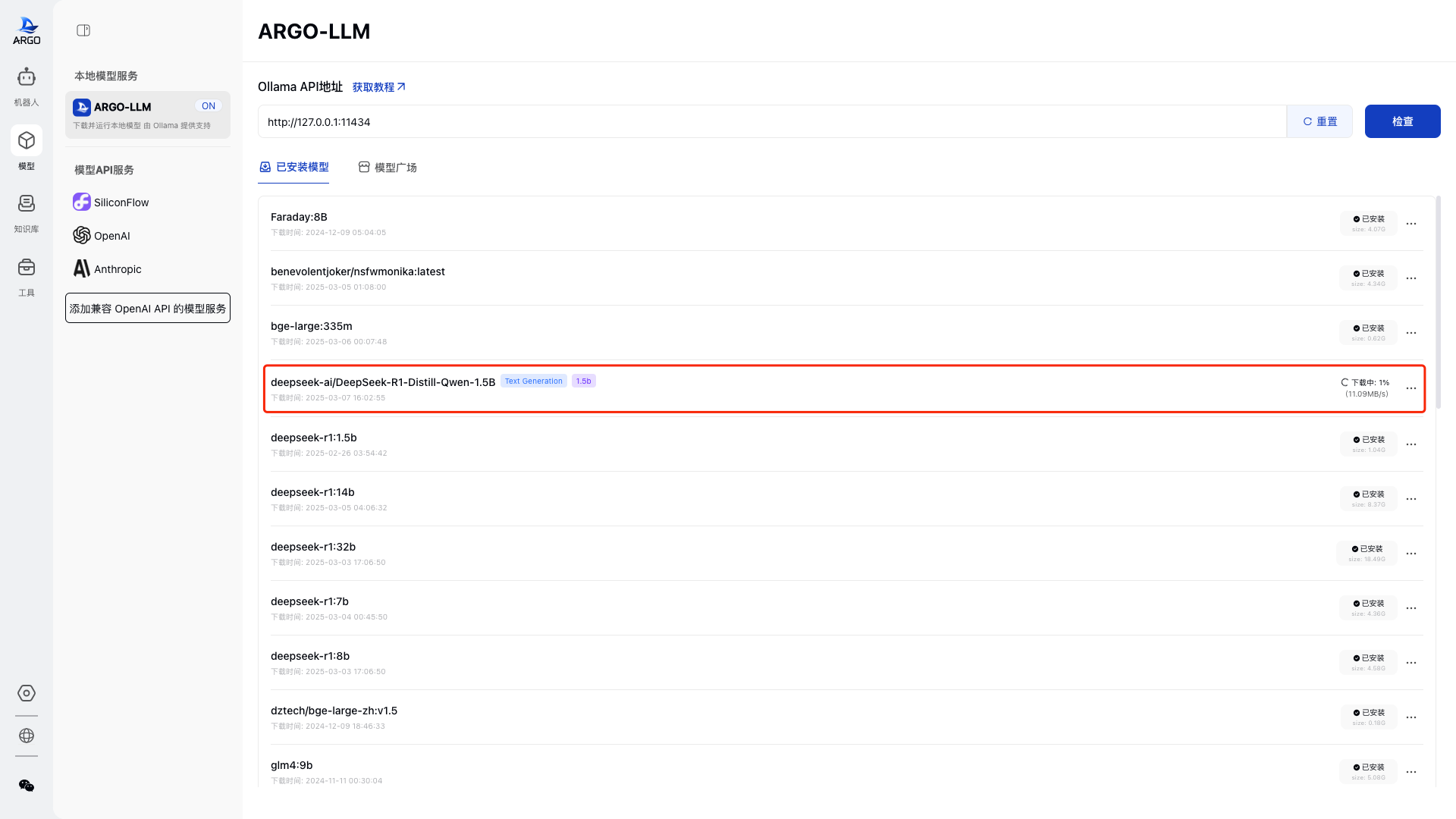

1. 本地模型配置

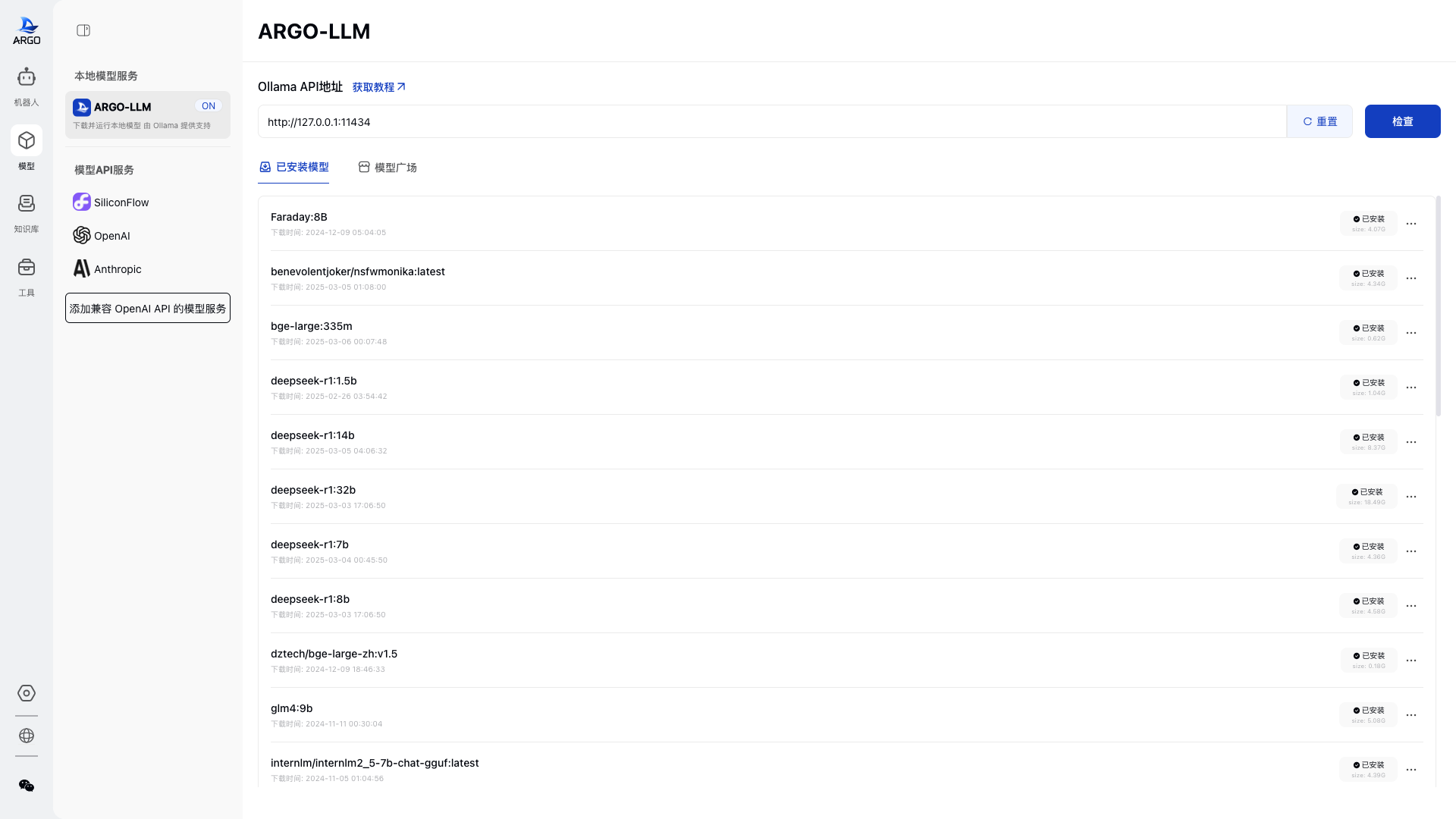

1.1 模型地址配置

默认情况下,Ollama 处于启用状态,系统会自动设置为本地地址。

- 修改地址:支持手动更改为远程 Ollama 服务器。

- 重置地址:点击 “重置” 按钮,恢复默认本地地址。

- 检测可用模型:点击 “检查” 按钮,系统将探测 Ollama 服务器上的可用模型,并在界��面上显示结果。

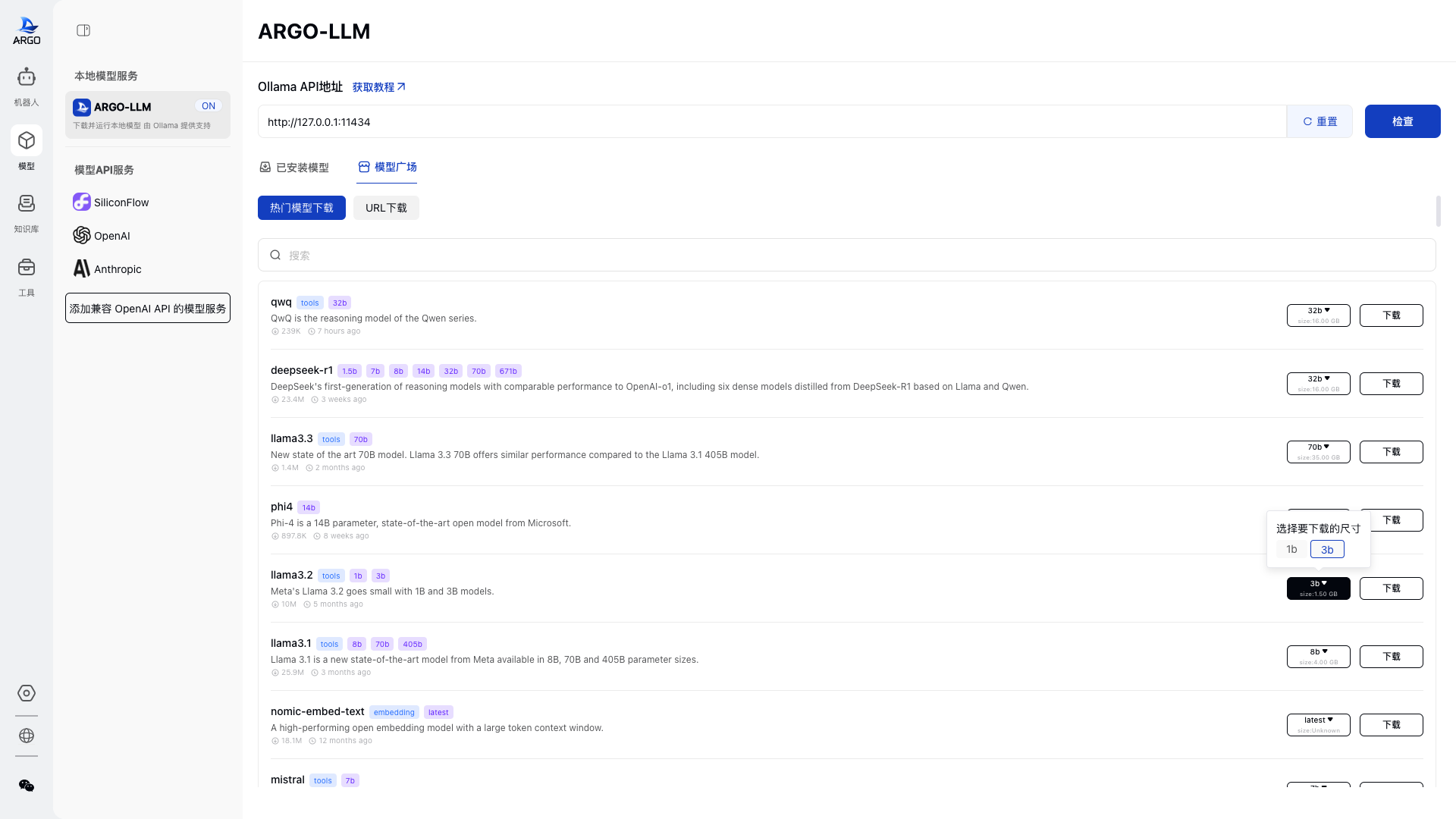

1.2 模型下载

1.2.1 热门模型下载

- 系统会根据设备的显存和内存情况,筛选适配的模型。

- 选择合适的模型规格后,点击 “下载” 按钮开始下载。

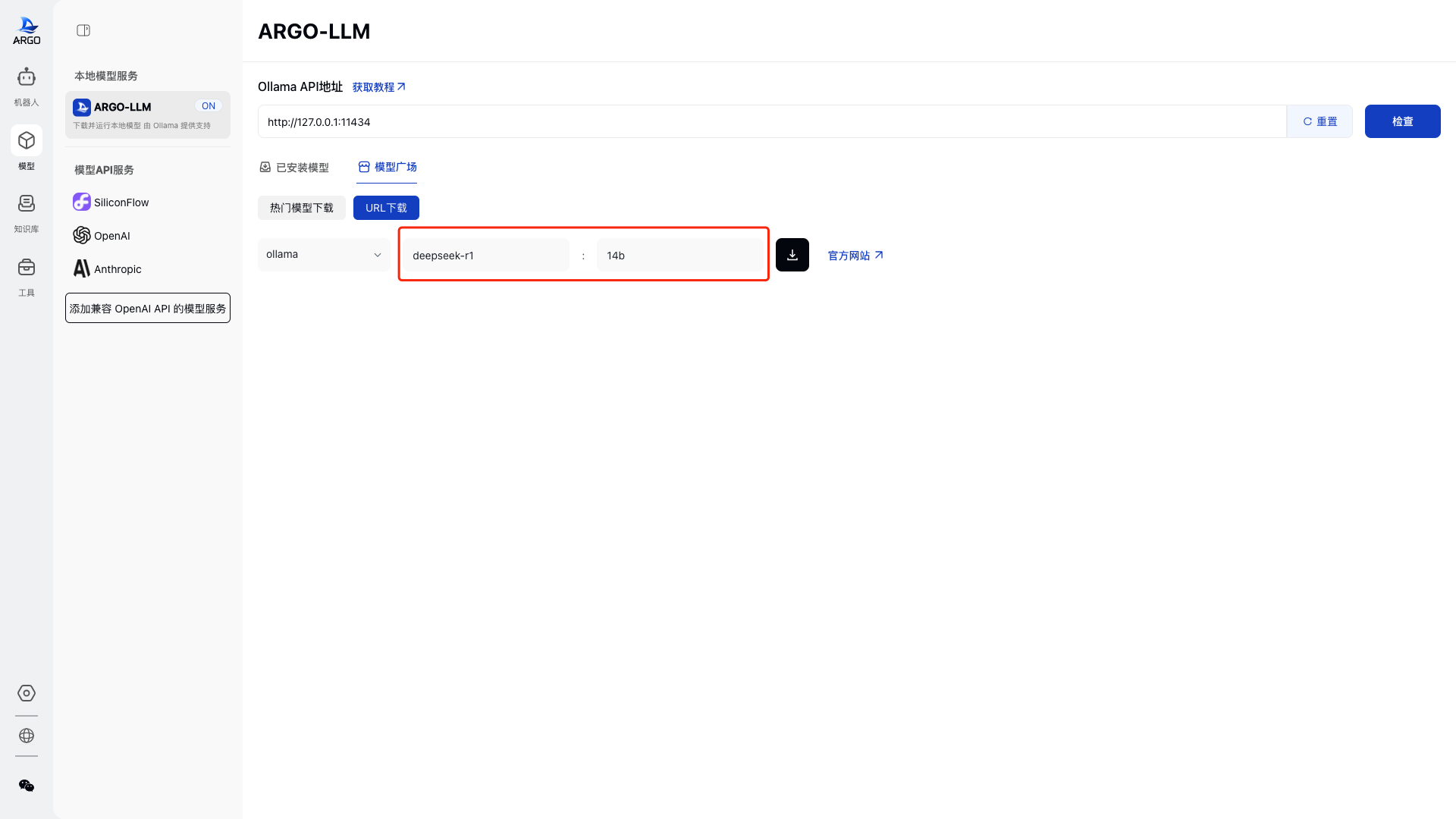

1.2.2 URL 下载(支持 Hugging Face 和 Ollama)

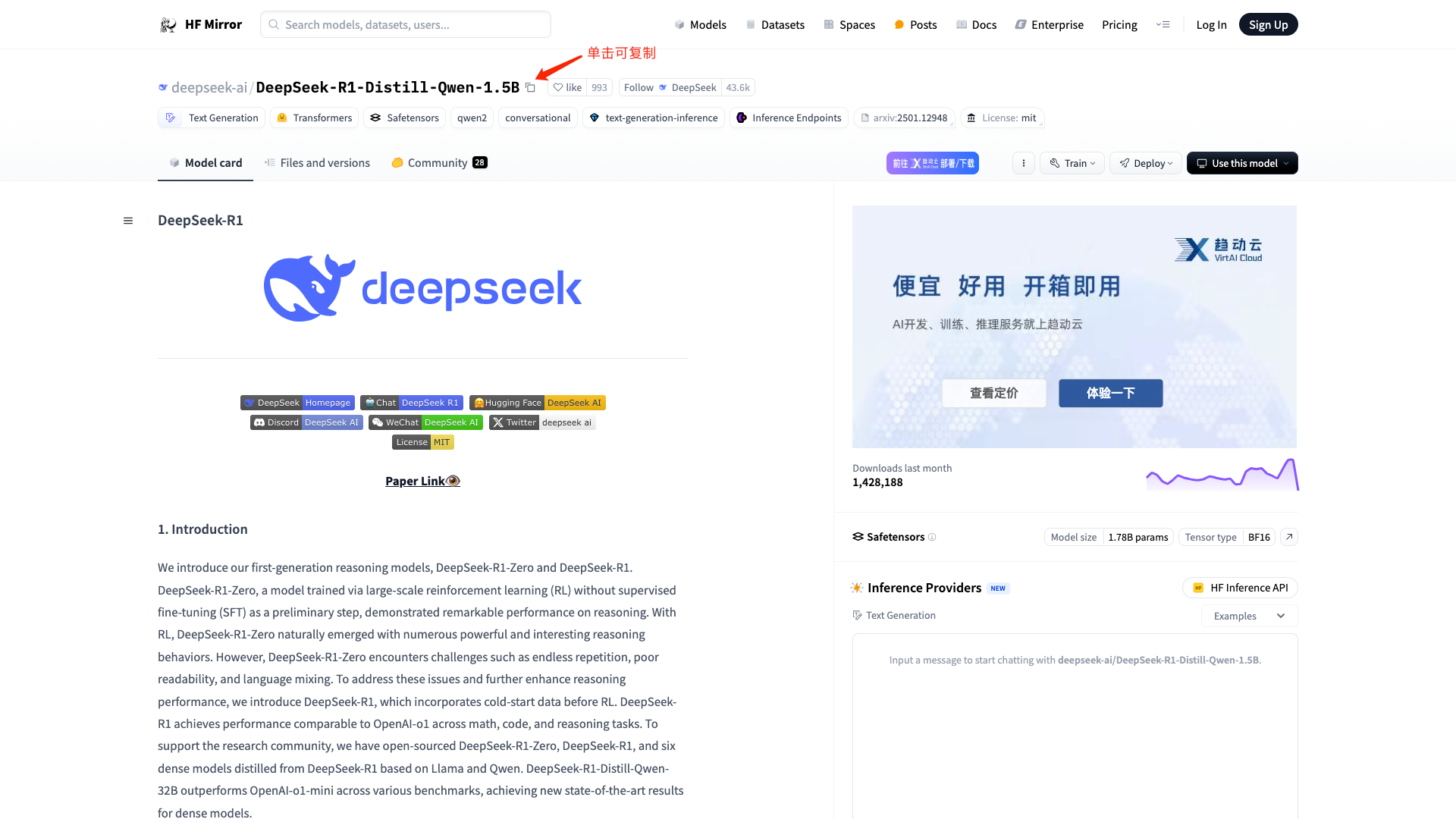

2. Hugging Face 模型下载指南

以 DeepSeek R1 Distill 为例,下载流程如下:

- 访问模型主页:DeepSeek R1 Distill

- 复制 模型 ID(如

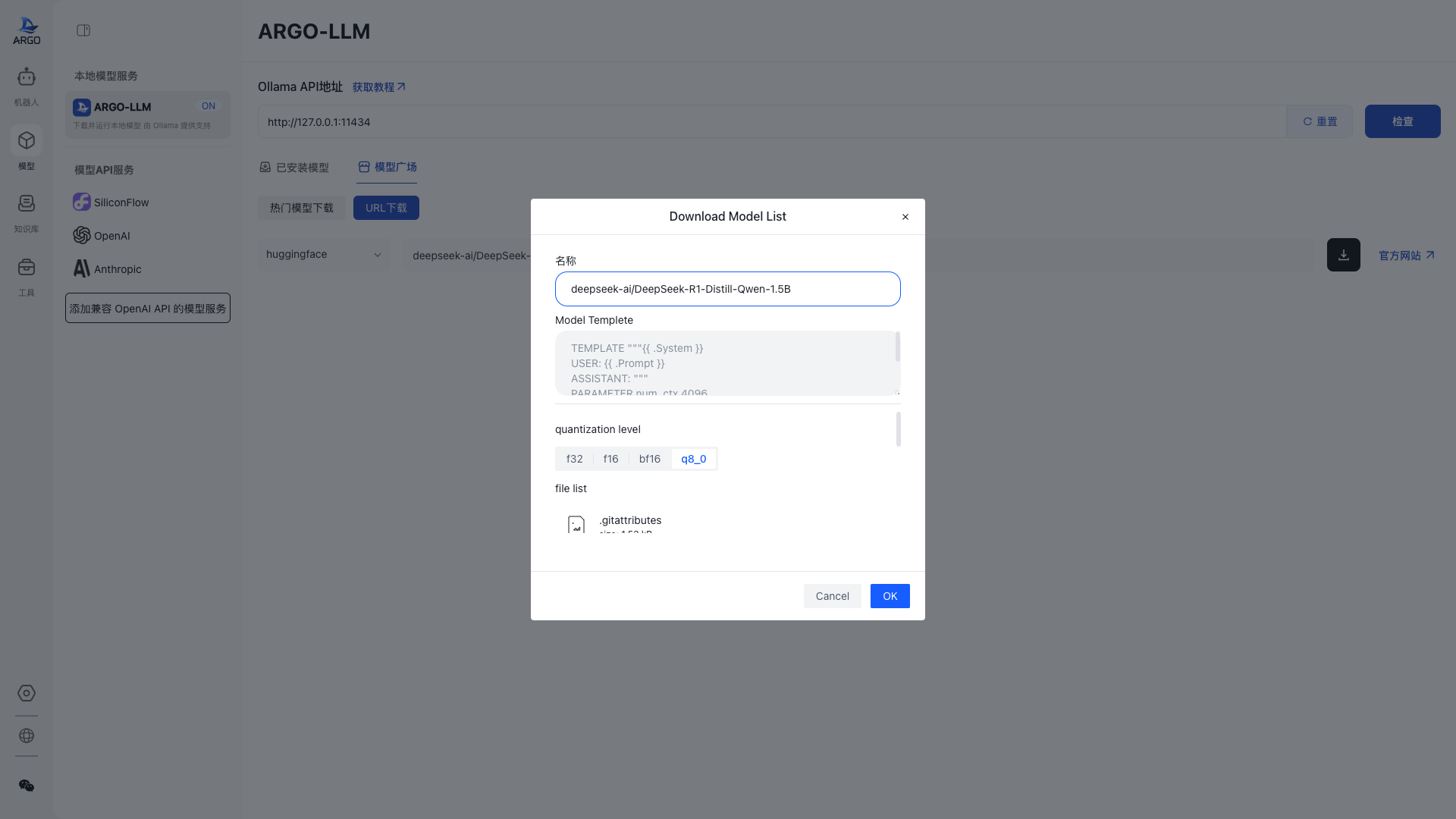

deepseek-ai/DeepSeek-R1-Distill-Qwen-1.5B)。 - 在 Argo > 模型 URL 下载 页面粘贴模型 ID。

- 点击 “下载” 按钮,系统解析并显示模型信息。

- 默认量化方式为

q8_0,可根据需求调整。 - 确认信息后,点击 “OK” 开始下载。

示例截图:

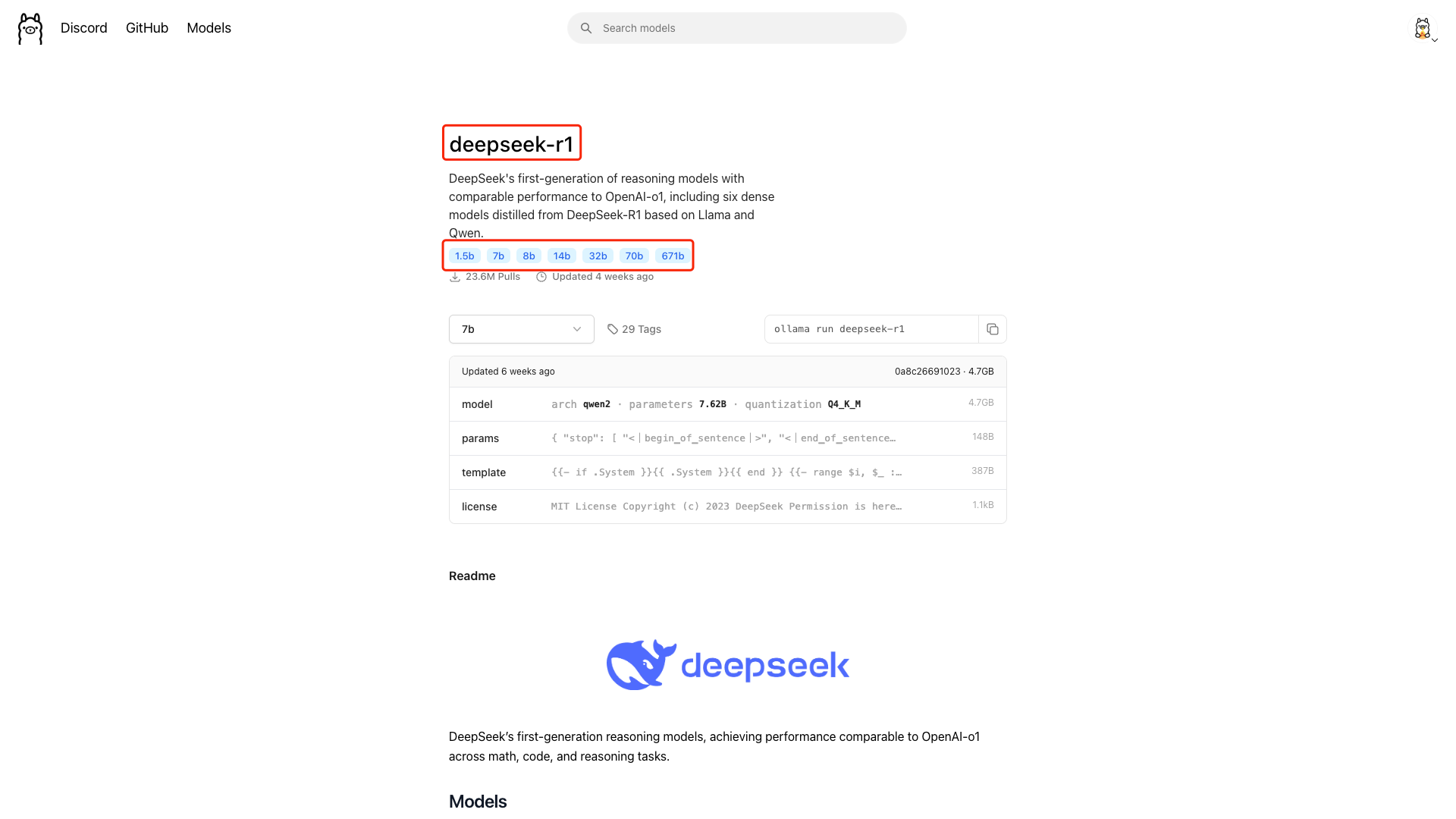

3. Ollama 模型下载指南

以 DeepSeek R1 为例,下载流程如下:

- 访问模型主页:DeepSeek R1

- 复制 模型 ID(如

deepseek-r1)和 模型规格(如14b)。 - 在 Argo > 模型 URL 下载 页面粘贴相关信息。

- 点击 “下载” 按钮,即可开始下载。

示例截图:

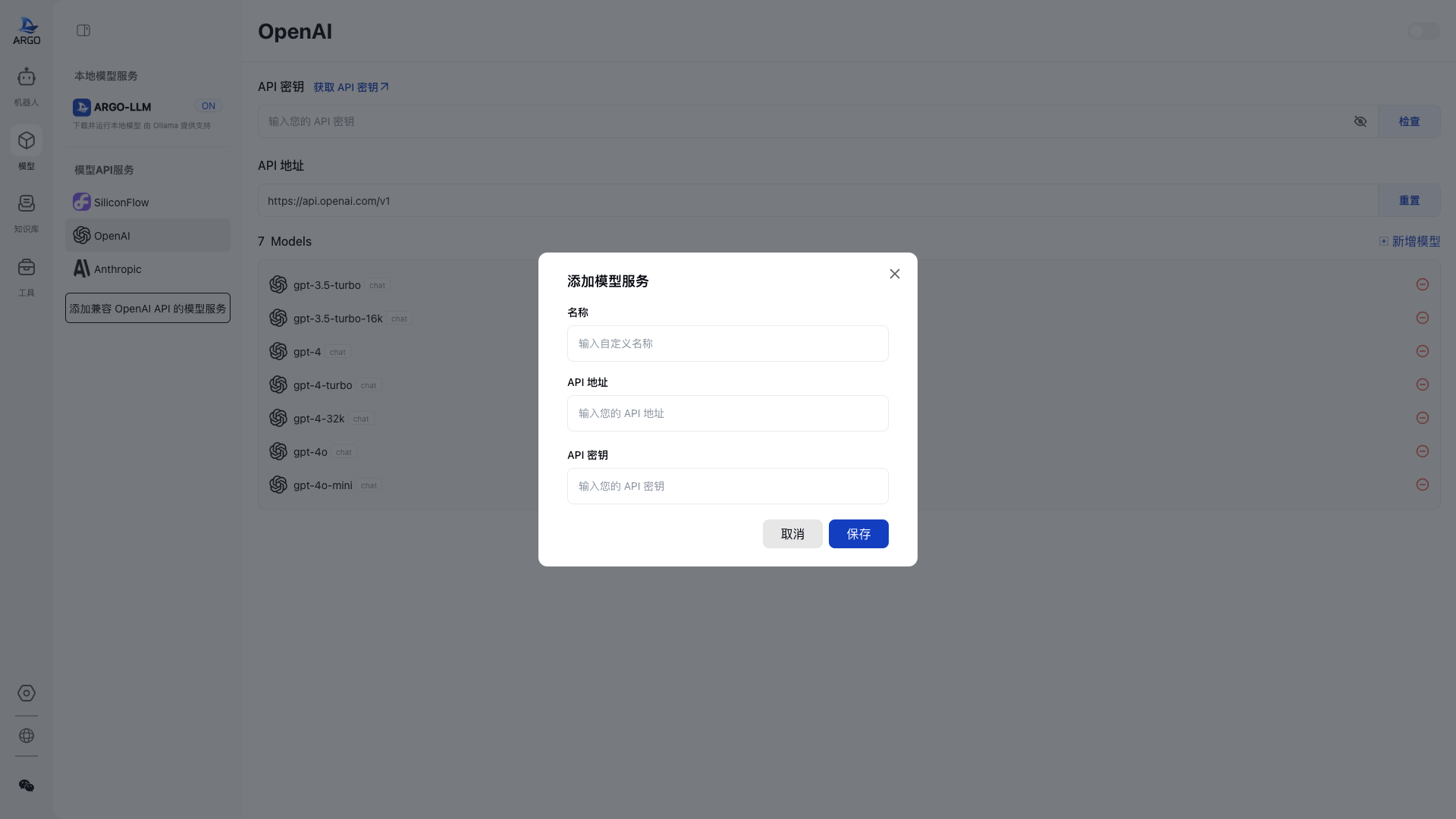

4. 模型 API 服务

Argo 支持多个 API 供应商,提供访问不同大模型的能力。

4.1 配置 API 访问

- 输入 API Key 并保存。

- 点击 “检查” 按钮,确保 API 可用。

- 通过开关按钮启用或禁用 API 供应商。

4.2 SiliconFlow 配置

- 访问 SiliconFlow 模型(如

Qwen/Qwen2.5-7B-Instruct、THUDM/glm-4-9b-chat)。 - 默认 API 地址:

https://api.siliconflow.cn/v1 - 需要 API Key 进行访问。

- 采用 OpenAI 官方 Python SDK 进行调用。

![]()

4.3 OpenAI 配置

- 访问 OpenAI 模型(如

gpt-4、gpt-4o)。 - 默认 API 地址:

https://api.openai.com/v1 - 需要 API Key 进行访问。

- 如果使用代理服务,请手动修改 API URL。

4.4 Anthropic 配置

- 访问 Anthropic 模型(如

claude、sonnet)。 - 默认 API 地址:

https://api.anthropic.com - 需要 API Key 进行访问。

- 支持代理,可手动修改 API URL。

4.5 自定义 OpenAI 兼容 API

- 支持 OpenAI 兼容 API,可使用 OpenAI 官方 SDK 调用。

- 需要提供 API Key 和 API URL,并可设置自定义名称。

5. 结语

通过本指南,您可以快速配置并使用本地或云端大模型服务。